hadoop完全分布式安装

一、完全分布式运行模式(开发重点)

分析:

1)准备3台客户机(hadoop101,hadoop102.hadoop103,关闭防火墙、静态ip、主机名称)

2)安装JDK1.8

3)配置环境变量

4)安装Hadoop2.7.2

5)配置环境变量

6)配置集群

7)配置ssh

8)群起并测试集群

2,安装JDK1.8

2.1 配置hosts

[yb@hadoop101 opt]$ sudo vi /etc/profile

加入自己的IP,我的是

192.168.1.101 hadoop101

192.168.1.102 hadoop102

192.168.1.103 hadoop103

在/opt目录下创建文件夹

(1)在/opt目录下创建module、software文件夹

[yb@hadoop101 opt]$ sudo mkdir module

[yb@hadoop101 opt]$ sudo mkdir software

(2)修改module、software文件夹的所有者cd

[yb@hadoop101 opt]$ sudo chown yb:yb module/ software/

[yb@hadoop101 opt]$ ll

总用量 8

drwxr-xr-x. 2 yb yb 4096 1月 17 14:37 module

drwxr-xr-x. 2 yb yb 4096 1月 17 14:38 software

2.2 安装JDK

2.2.1 卸载现有JDK

(1)查询是否安装Java软件:

[yb@hadoop101 opt]$ rpm -qa | grep java

(2)如果安装的版本低于1.7,卸载该JDK:

[yb@hadoop101 opt]$ sudo rpm -e 软件包

(3)查看JDK安装路径:

[yb@hadoop101 ~]$ which java

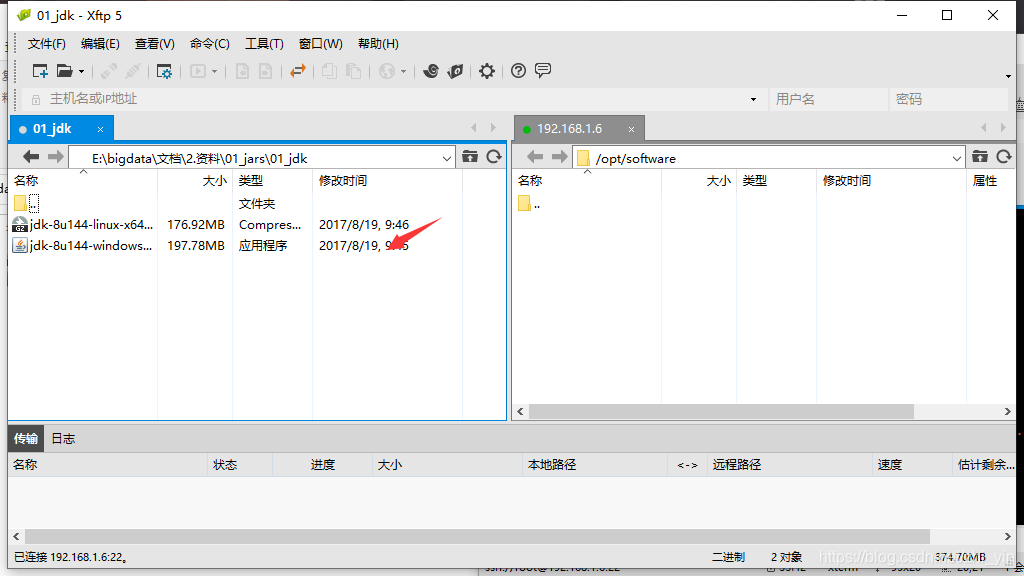

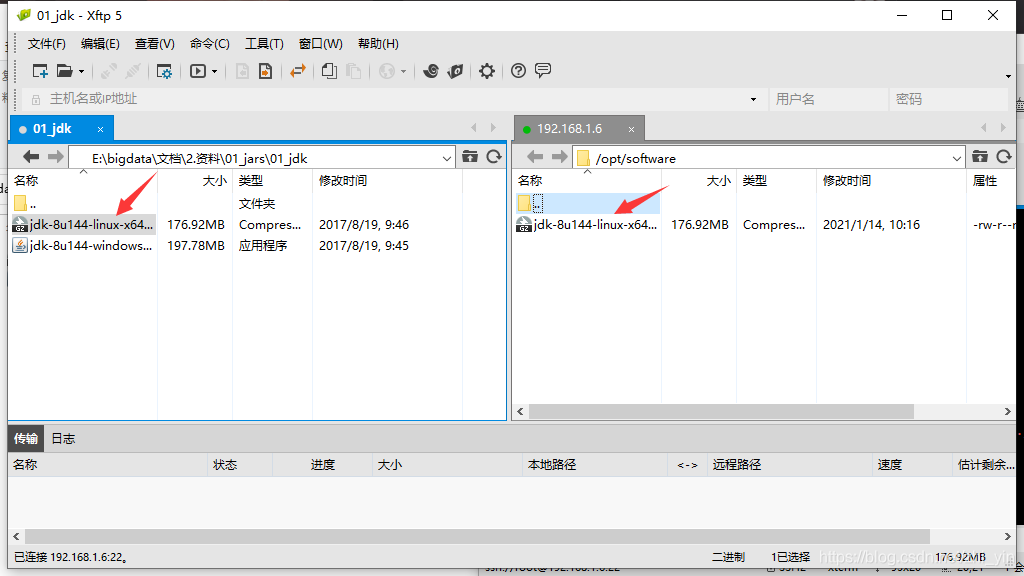

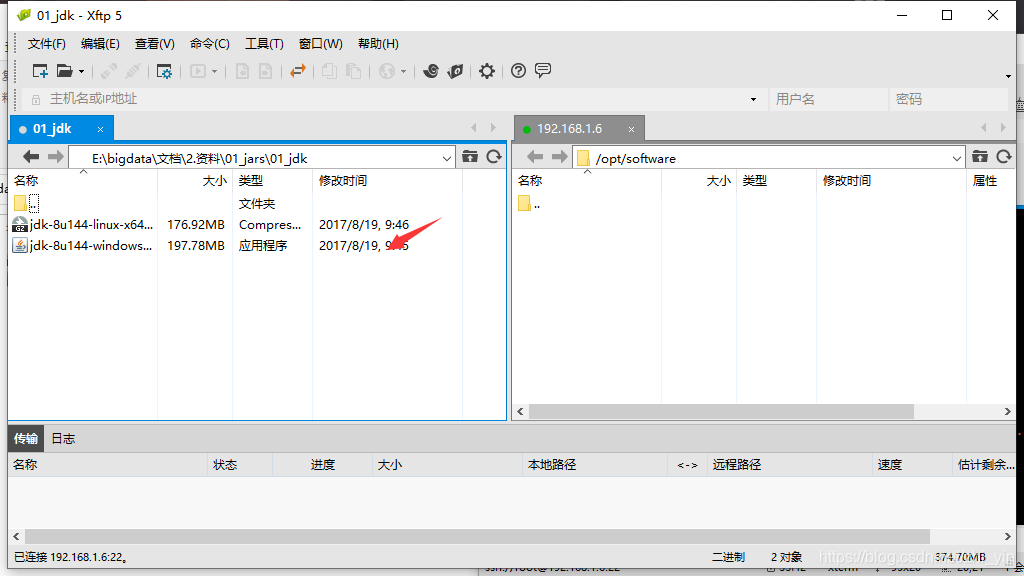

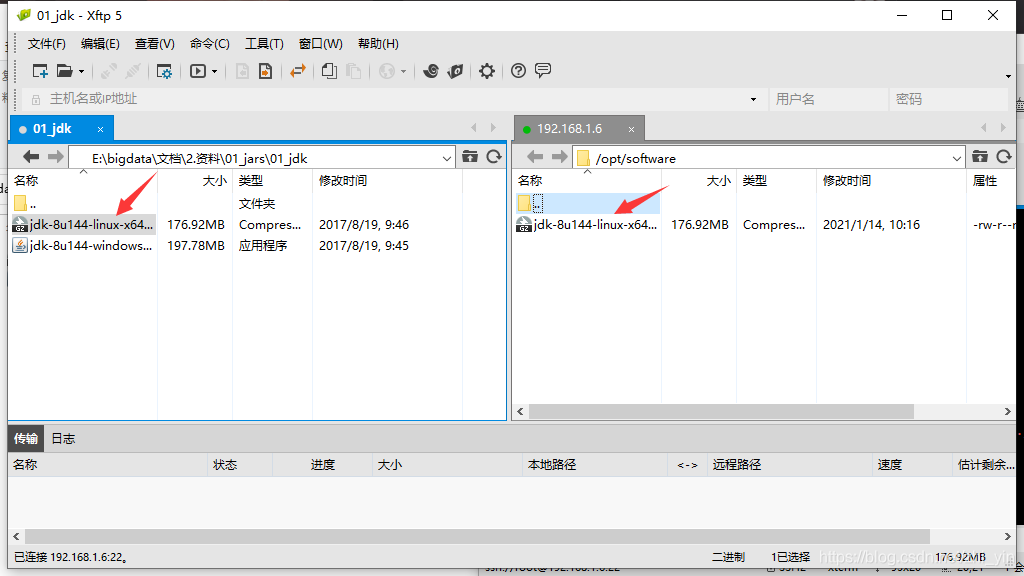

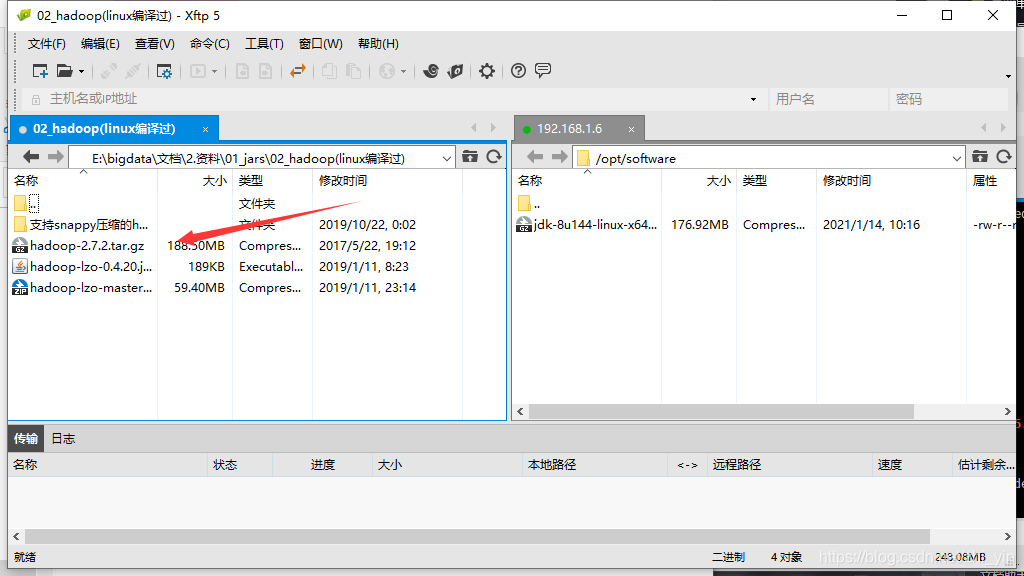

2.3 用Shell工具将JDK导入到opt目录下面的software文件夹下面,如图1.3所示

2.3.1在Linux系统下的opt目录中查看软件包是否导入成功

[yb@hadoop101 opt]$ cd software/

[yb@hadoop101 software]$ ls

jdk-8u144-linux-x64.tar.gz

2.3.2.解压JDK到/opt/module目录下

[yb@hadoop101 software]$ tar -zxvf jdk-8u144-linux-x64.tar.gz -C /opt/module/

3 配置JDK环境变量

(1)先获取JDK路径

[yb@hadoop101 jdk1.8.0_144]$ pwd

/opt/module/jdk1.8.0_144

(2)打开/etc/profile文件

[yb@hadoop101 software]$ sudo vi /etc/profile

在profile文件末尾添加JDK路径

#JAVA_HOME

export JAVA_HOME=/opt/module/jdk1.8.0_144

export PATH=$PATH:$JAVA_HOME/bin

(3)保存后退出

:wq

(4)让修改后的文件生效

[yb@hadoop101 jdk1.8.0_144]$ source /etc/profile

3.1 测试JDK是否安装成功

[yb@hadoop101 jdk1.8.0_144]# java -version

java version "1.8.0_144"

注意:重启(如果java -version可以用就不用重启)

[yb@hadoop101 jdk1.8.0_144]$ sudo reboot

4 安装Hadoop

4.1 Hadoop下载地址:

https://archive.apache.org/dist/hadoop/common/hadoop-2.7.2/

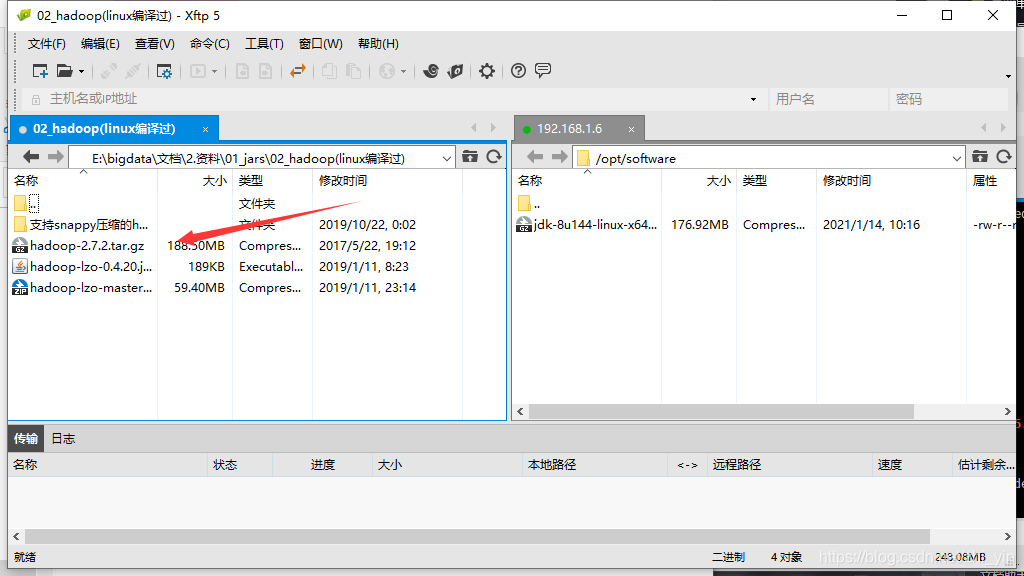

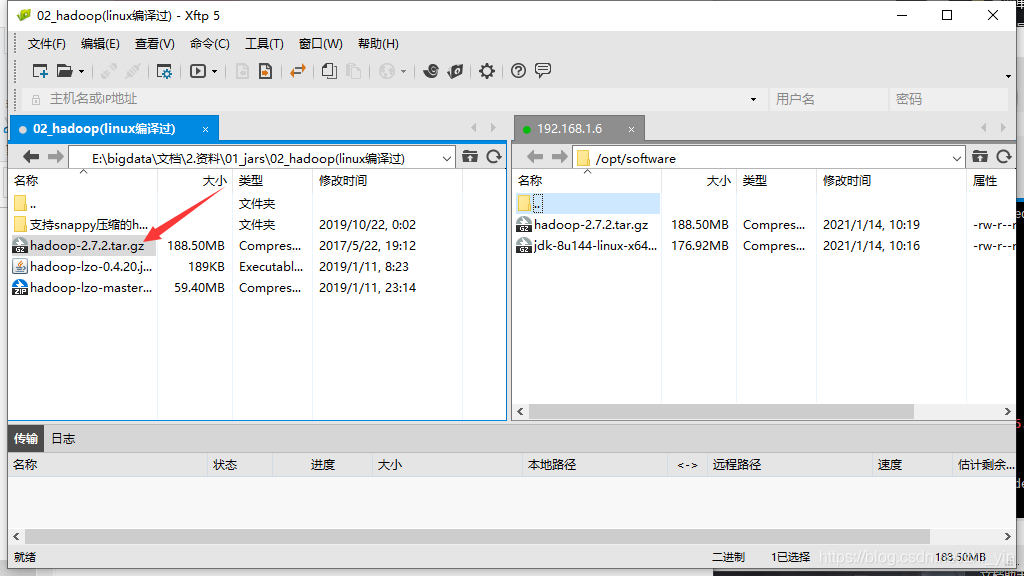

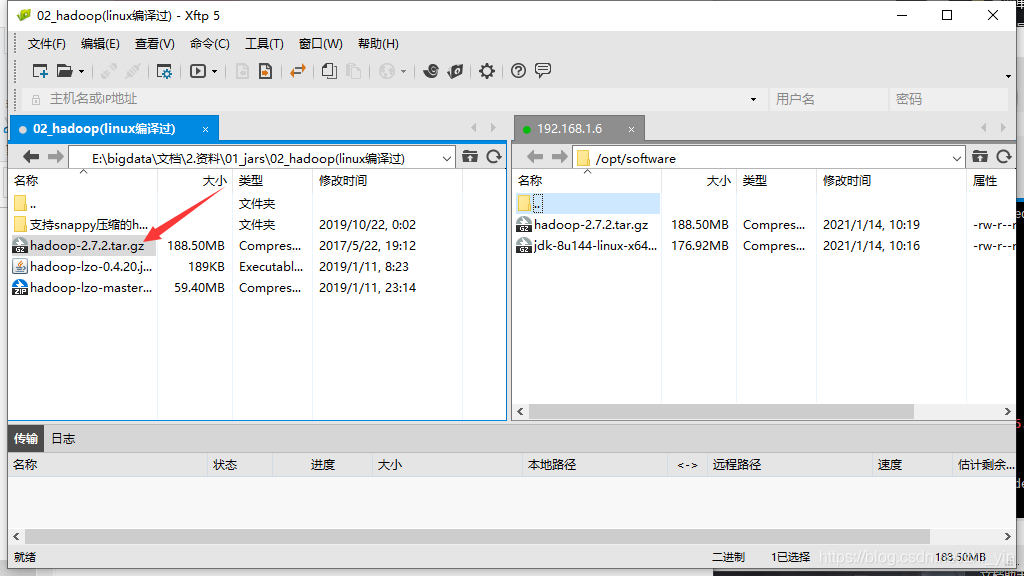

4.2 用Shell工具将hadoop-2.7.2.tar.gz导入到opt目录下面的software文件夹下面

查看Hadoop2.7.2

[yb@hadoop101 software]# ll

总用量 374196

-rw-r--r--. 1 root root 197657687 1月 14 10:19 hadoop-2.7.2.tar.gz

-rw-r--r--. 1 root root 185515842 1月 14 10:16 jdk-8u144-linux-x64.tar.gz

4.3 进入到Hadoop安装包路径下

[yb@hadoop101 ~]$ cd /opt/software/

4.4 解压安装文件到/opt/module下面

[yb@hadoop101 software]$ tar -zxvf hadoop-2.7.2.tar.gz -C /opt/module/

4.5 查看是否解压成功

[yb@hadoop101 software]$ ls /opt/module/

hadoop-2.7.2

5 配置Hadoop环境变量

5.1 将Hadoop添加到环境变量

(1)获取Hadoop安装路径

[yb@hadoop101 hadoop-2.7.2]$ pwd

/opt/module/hadoop-2.7.2

(2)打开/etc/profile文件

[yb@hadoop101 hadoop-2.7.2]$ sudo vi /etc/profile

在profile文件末尾添加JDK路径:(shitf+g)

##HADOOP_HOME

export HADOOP_HOME=/opt/module/hadoop-2.7.2

export PATH=$PATH:$HADOOP_HOME/bin

export PATH=$PATH:$HADOOP_HOME/sbin

(3)保存后退出

:wq

(4)让修改后的文件生效

[yb@ hadoop101 hadoop-2.7.2]$ source /etc/profile

5.2 测试是否安装成功

[yb@hadoop101 hadoop-2.7.2]$ hadoop version

Hadoop 2.7.2

5.3 Hadoop目录结构

1)查看Hadoop目录结构

[yb@hadoop101 hadoop-2.7.2]$ ll

总用量 52

drwxr-xr-x. 2 yb yb 4096 5月 22 2017 bin

drwxr-xr-x. 3 yb yb 4096 5月 22 2017 etc

drwxr-xr-x. 2 yb yb 4096 5月 22 2017 include

drwxr-xr-x. 3 yb yb 4096 5月 22 2017 lib

drwxr-xr-x. 2 yb yb 4096 5月 22 2017 libexec

-rw-r--r--. 1 yb yb 15429 5月 22 2017 LICENSE.txt

-rw-r--r--. 1 yb yb 101 5月 22 2017 NOTICE.txt

-rw-r--r--. 1 yb yb 1366 5月 22 2017 README.txt

drwxr-xr-x. 2 yb yb 4096 5月 22 2017 sbin

drwxr-xr-x. 4 yb yb 4096 5月 22 2017 share

2)重要目录

(1)bin目录:存放对Hadoop相关服务(HDFS,YARN)进行操作的脚本

(2)etc目录:Hadoop的配置文件目录,存放Hadoop的配置文件

(3)lib目录:存放Hadoop的本地库(对数据进行压缩解压缩功能)

(4)sbin目录:存放启动或停止Hadoop相关服务的脚本

(5)share目录:存放Hadoop的依赖jar包、文档、和官方案例

5.4 编写集群分发脚本xsync

5.4.1 scp(secure copy)安全拷贝

(1)scp定义:

scp可以实现服务器与服务器之间的数据拷贝。(from server1 to server2)

(2)基本语法

scp -r $pdir/$fname $user@hadoop$host:$pdir/$fname

命令 递归 要拷贝的文件路径/名称 目的用户@主机:目的路径/名称

3)案例实操

a)在hadoop101上,将hadoop101中/opt/module目录下的软件拷贝到hadoop102上。

[yb@hadoop101 /]$ scp -r /opt/module root@hadoop102:/opt/module

(b)在hadoop101上,将hadoop101服务器上的/opt/module目录下的软件拷贝到hadoop103上。

[yb@hadoop101 opt]$sudo scp -r yb@hadoop101:/opt/module root@hadoop103:/opt/module

注意:拷贝过来的/opt/module目录,别忘了在hadoop101、hadoop102、hadoop103上修改所有文件的,所有者和所有者组。

sudo chown yb:yb -R /opt/module

(c)将hadoop101中/etc/profile文件拷贝到hadoop102的/etc/profile上。

[yb@hadoop101 ~]$ sudo scp /etc/profile root@hadoop102:/etc/profile

(d)将hadoop101中/etc/profile文件拷贝到hadoop103的/etc/profile上。

[yb@hadoop101 ~]$ sudo scp /etc/profile root@hadoop103:/etc/profile

注意:拷贝过来的配置文件别忘了source一下

/etc/profile

5.5 rsync 远程同步工具

rsync主要用于备份和镜像。具有速度快、避免复制相同内容和支持符号链接的优点。

rsync和scp区别:用rsync做文件的复制要比scp的速度快,rsync只对差异文件做更新。scp是把所有文件都复制过去。

(1)基本语法

rsync -rvl $pdir/$fname $user@hadoop$host:$pdir/$fname

命令 选项参数 要拷贝的文件路径/名称 目的用户@主机:目的路径/名称

选项参数说明

表2-2

选项 功能

-r 递归

-v 显示复制过程

-l 拷贝符号连接

(2)案例实操

(a)把hadoop101机器上的/opt/software目录同步到hadoop102服务器的root用户下的/opt/目录

[yb@hadoop101 opt]$ rsync -rvl /opt/software/ root@hadoop102:/opt/software

5.5.1 xsync集群分发脚本

(1)需求:循环复制文件到所有节点的相同目录下

(2)需求分析:

(a)rsync命令原始拷贝:

rsync -rvl /opt/module root@hadoop103:/opt/

(b)期望脚本:

xsync要同步的文件名称

c)说明:在/home/yb/bin这个目录下存放的脚本,yb用户可以在系统任何地方直接执行。

(3)脚本实现

(a)在/home/yb目录下创建bin目录,并在bin目录下xsync创建文件,文件内容如下:

[yb@hadoop101 ~]$ mkdir bin

[yb@hadoop101 ~]$ cd bin/

[yb@hadoop101 bin]$ touch xsync

[yb@hadoop101 bin]$ vi xsync

在该文件中编写如下代码

#!/bin/bash

#1 获取输入参数个数,如果没有参数,直接退出

pcount=$#

if((pcount==0)); then

echo no args;

exit;

fi

#2 获取文件名称

p1=$1

fname=`basename $p1`

echo fname=$fname

#3 获取上级目录到绝对路径

pdir=`cd -P $(dirname $p1); pwd`

echo pdir=$pdir

#4 获取当前用户名称

user=`whoami`

#5 循环

for((host=101; host<104; host++)); do

echo ------------------- hadoop$host --------------

rsync -rvl $pdir/$fname $user@hadoop$host:$pdir

done

(b)修改脚本 xsync 具有执行权限

[yb@hadoop101 bin]$ chmod 777 xsync

(c)调用脚本形式:xsync 文件名称

[yb@hadoop101 bin]$ xsync /home/yb/bin

注意:如果将xsync放到/home/yb/bin目录下仍然不能实现全局使用,可以将xsync移动到/usr/local/bin目录下。

6 集群配置

6.1 集群部署规划

| hadoop101 | hadoop101 | hadoop101 |

|---|

| NameNode | DataNode | DataNode |

| DataNode | ResourceManager | SecondaryNameNode |

| NodeManager | NodeManager | NodeManager |

6.2 配置集群

(1)核心配置文件

配置core-site.xml

[yb@hadoop101 ~]$ cd /opt/model/hadoop-2.7.2/etc/hadoop/

[yb@hadoop101 hadoop]$ vi core-site.xml

在该文件中编写如下配置

<!-- 指定HDFS中NameNode的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://192.168.1.101