K8S

һ������

1.1 �����б�

| ������ | Centos�汾 | ip | docker version | flannel version | Keepalived version | �������� | ��ע |

|---|

| lvs-keepalived01 | 7.6.1810 | 172.27.34.28 | / | / | v1.3.5 | 4C4G | lvs-keepalived |

| lvs-keepalived01 | 7.6.1810 | 172.27.34.29 | / | / | v1.3.5 | 4C4G | lvs-keepalived |

| master01 | 7.6.1810 | 172.27.34.35 | 18.09.9 | v0.11.0 | / | 4C4G | control plane |

| master02 | 7.6.1810 | 172.27.34.36 | 18.09.9 | v0.11.0 | / | 4C4G | control plane |

| master03 | 7.6.1810 | 172.27.34.37 | 18.09.9 | v0.11.0 | / | 4C4G | control plane |

| work01 | 7.6.1810 | 172.27.34.161 | 18.09.9 | / | / | 4C4G | worker nodes |

| work02 | 7.6.1810 | 172.27.34.162 | 18.09.9 | / | / | 4C4G | worker nodes |

| work03 | 7.6.1810 | 172.27.34.163 | 18.09.9 | / | / | 4C4G | worker nodes |

| VIP | 7.6.1810 | 172.27.34.222 | / | / | v1.3.5 | 4C4G | ��lvs-keepalived��̨�����ϸ��� |

| client | 7.6.1810 | 172.27.34.85 | / | / | / | 4C4G | client |

����9̨������,2̨Ϊlvs-keepalived��Ⱥ,3̨control plane��Ⱥ,3̨work��Ⱥ,1̨client��

1.2 k8s �汾

| ������ | kubelet version | kubeadm version | kubectl version | ��ע |

|---|

| master01 | v1.16.4 | v1.16.4 | v1.16.4 | kubectlѡװ |

| master02 | v1.16.4 | v1.16.4 | v1.16.4 | kubectlѡװ |

| master03 | v1.16.4 | v1.16.4 | v1.16.4 | kubectlѡװ |

| work01 | v1.16.4 | v1.16.4 | v1.16.4 | kubectlѡװ |

| work02 | v1.16.4 | v1.16.4 | v1.16.4 | kubectlѡװ |

| work03 | v1.16.4 | v1.16.4 | v1.16.4 | kubectlѡװ |

| client | / | / | v1.16.4 | client |

�����߿��üܹ�

1. �ܹ�ͼ

���IJ���kubeadm��ʽ��߿���k8s��Ⱥ,k8s��Ⱥ�ĸ߿���ʵ����k8s����������ĸ߿���,����ʹ����Ⱥģʽ(���apiserver����),�ܹ�����:

[����ͼƬת��ʧ��,Դվ�����з���������,���齫ͼƬ��������ֱ���ϴ�(img-bONSy2pD-1626275361623)(https://i.loli.net/2020/03/09/n7l4JwAC23gemId.png)]

2. ��Ⱥģʽ�߿��üܹ�˵��

| ������� | �߿���ģʽ | �߿���ʵ�ַ�ʽ |

|---|

| apiserver | ��Ⱥ | lvs+keepalived |

| controller-manager | ���� | leader election |

| scheduler | ���� | leader election |

| etcd | ��Ⱥ | kubeadm |

- apiserver ͨ��lvs-keepalivedʵ�ָ߿���,vip������ַ�������control plane�ڵ��apiserver���;

- controller-manager k8s�ڲ�ͨ��ѡ�ٷ�ʽ�����쵼��(�ɨCleader-elect ѡ�Ϳ���,Ĭ��Ϊtrue),ͬһʱ�̼�Ⱥ��ֻ��һ��controller-manager�������;

- scheduler k8s�ڲ�ͨ��ѡ�ٷ�ʽ�����쵼��(�ɨCleader-elect ѡ�Ϳ���,Ĭ��Ϊtrue),ͬһʱ�̼�Ⱥ��ֻ��һ��scheduler�������;

- etcd ͨ������kubeadm��ʽ�Զ�������Ⱥ��ʵ�ָ߿���,����Ľڵ���Ϊ����,3�ڵ㷽ʽ�������һ̨����崻���

������װ������

1. ����������

1.1 ��������

[root@centos7 ~]

[root@centos7 ~]

master01

�˳����µ�½������ʾ�����õ�������master01

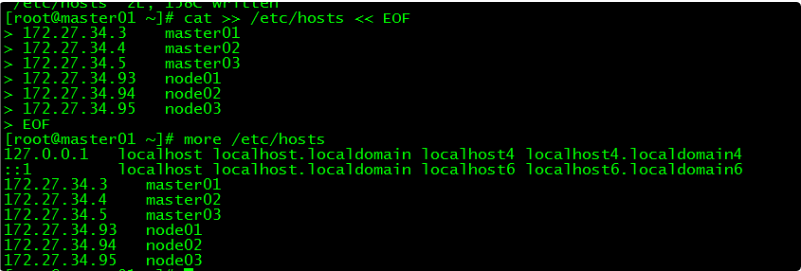

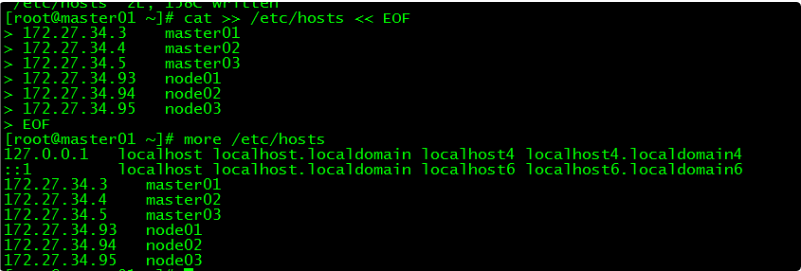

1.2 ��hosts�ļ�

[root@master01 ~]

192.168.40.144 master01

192.168.40.146 master02

192.168.40.148 master03

192.168.40.150 work01

192.168.40.152 work02

192.168.40.154 work03

EOF

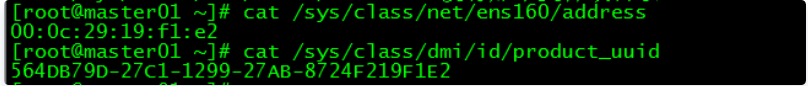

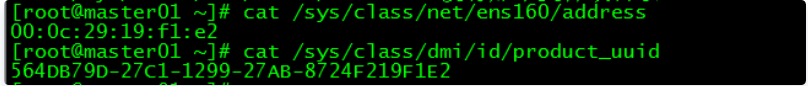

2. ��֤mac��ַuuid

[root@master01 ~]

[root@master01 ~]

��֤���ڵ�mac��uuidΨһ

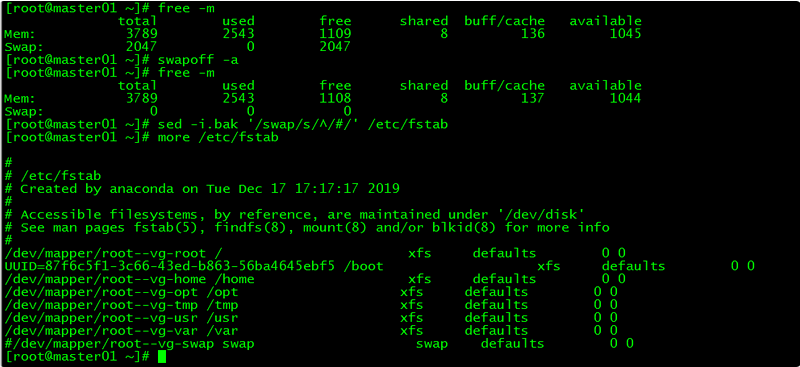

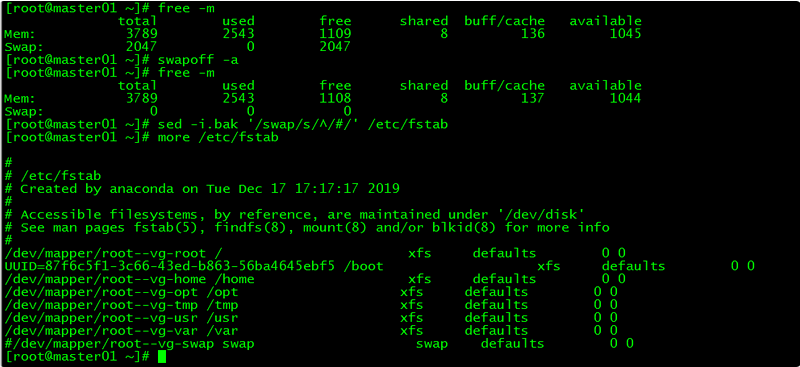

3. ����swap

3.1 ��ʱ����

[root@master01 ~]

3.2 ���ý���

����Ҫ������Ҳ��Ч,�ڽ���swap�����������ļ�/etc/fstab,ע��swap

[root@master01 ~]

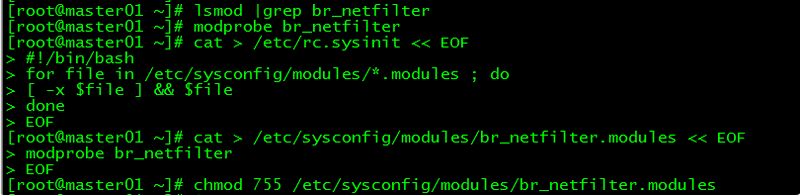

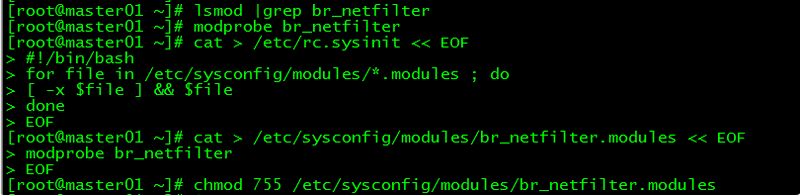

4. �ں˲�����

���ĵ�k8s����ʹ��flannel,��������Ҫ�����ں˲���bridge-nf-call-iptables=1,�����������Ҫϵͳ��br_netfilterģ�顣

4.1 br_netfilterģ�����

�鿴br_netfilterģ��:

[root@master01 ~]

���ϵͳû��br_netfilterģ����ִ���������������,��������ԡ�

��ʱ����br_netfilterģ��:

[root@master01 ~]

�÷�ʽ�������ʧЧ

��������br_netfilterģ��:

[root@master01 ~]

for file in /etc/sysconfig/modules/*.modules ; do

[ -x $file ] && $file

done

EOF

[root@master01 ~]

modprobe br_netfilter

EOF

[root@master01 ~]

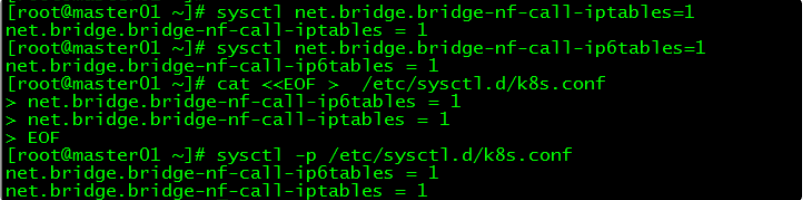

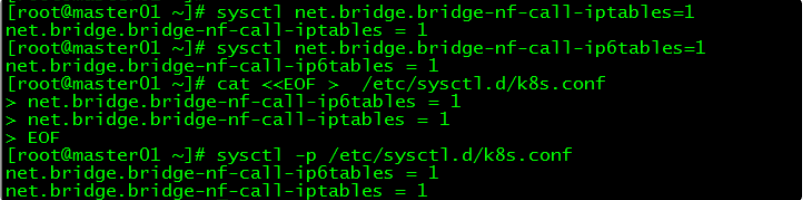

4.2 �ں˲�����ʱ��

[root@master01 ~]

net.bridge.bridge-nf-call-iptables = 1

[root@master01 ~]

net.bridge.bridge-nf-call-ip6tables = 1

4.3 �ں˲���������

[root@master01 ~]

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

EOF

[root@master01 ~]

net.bridge.bridge-nf-call-ip6tables = 1

net.bridge.bridge-nf-call-iptables = 1

5. ����kubernetesԴ

5.1 ����kubernetesԴ

[root@master01 ~]

[kubernetes]

name=Kubernetes

baseurl=https://mirrors.aliyun.com/kubernetes/yum/repos/kubernetes-el7-x86_64/

enabled=1

gpgcheck=1

repo_gpgcheck=1

gpgkey=https://mirrors.aliyun.com/kubernetes/yum/doc/yum-key.gpg https://mirrors.aliyun.com/kubernetes/yum/doc/rpm-package-key.gpg

EOF

- [] �������е���repository id,Ψһ,������ʶ��ͬ�ֿ�

- name �ֿ�����,�Զ���

- baseurl �ֿ��ַ

- enable �Ƿ����øòֿ�,Ĭ��Ϊ1��ʾ����

- gpgcheck �Ƿ���֤�Ӹòֿ��ó�����ĺϷ���,1Ϊ��֤

- repo_gpgcheck �Ƿ���֤Ԫ���ݵĺϷ��� Ԫ���ݾ��dz�����б�,1Ϊ��֤

- gpgkey=URL ����ǩ���Ĺ�Կ�ļ�����λ��,���gpgcheckֵΪ1,�˴�����Ҫָ��gpgkey�ļ���λ��,���gpgcheckֵΪ0�Ͳ���Ҫ������

5.2 ���»���

����Ԫ����

[root@master01 ~]

[root@master01 ~]

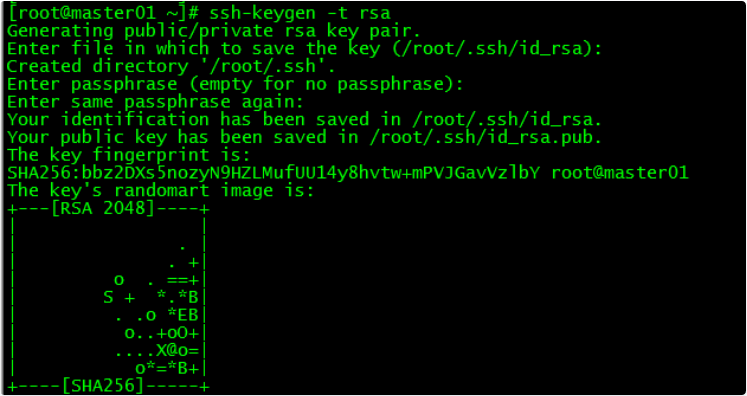

6. ���ܵ�¼

����master01��master02��master03���ܵ�¼,������ֻ��master01��ִ�С�

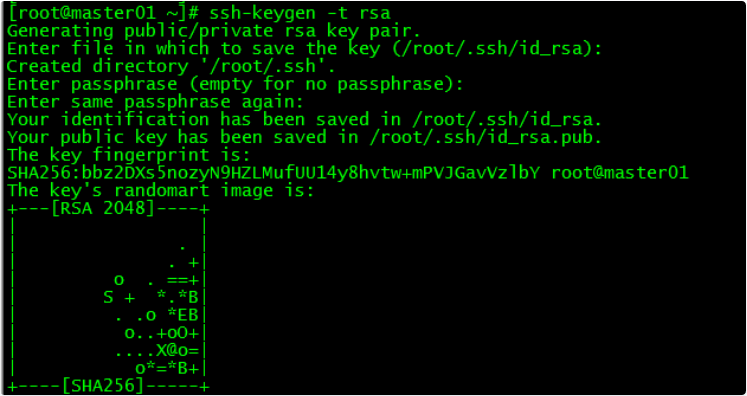

6.1 ������Կ

[root@master01 ~]

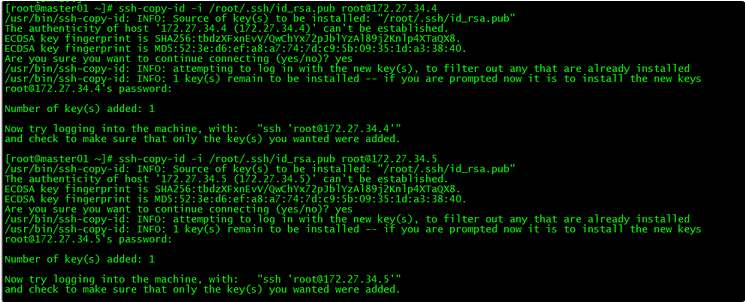

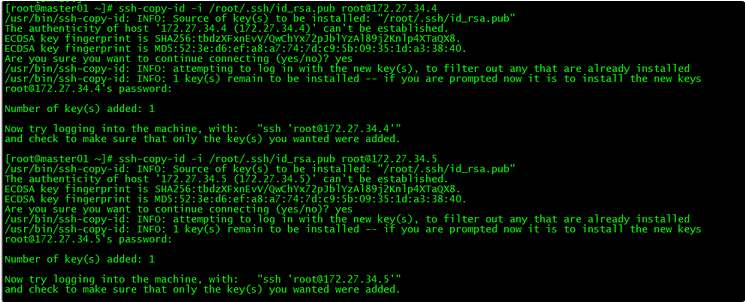

6.2 ����Կͬ����master02/master03

[root@master01 ~]

[root@master01 ~]

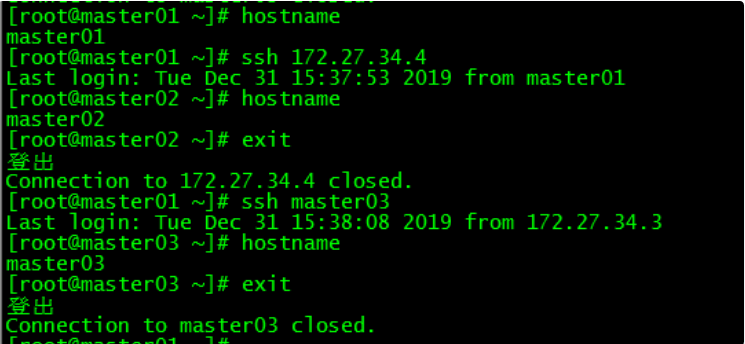

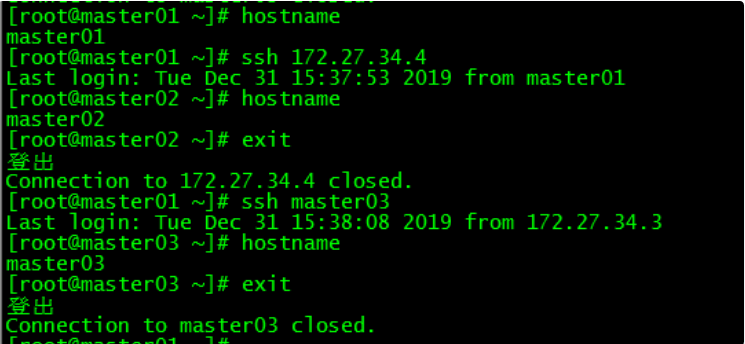

6.3 ���ܵ�½����

[root@master01 ~]

[root@master01 ~]

master01����ֱ�ӵ�¼master02��master03,����Ҫ�������롣

�ġ�Docker��װ

control plane��work�ڵ㶼ִ�б����ֲ�����

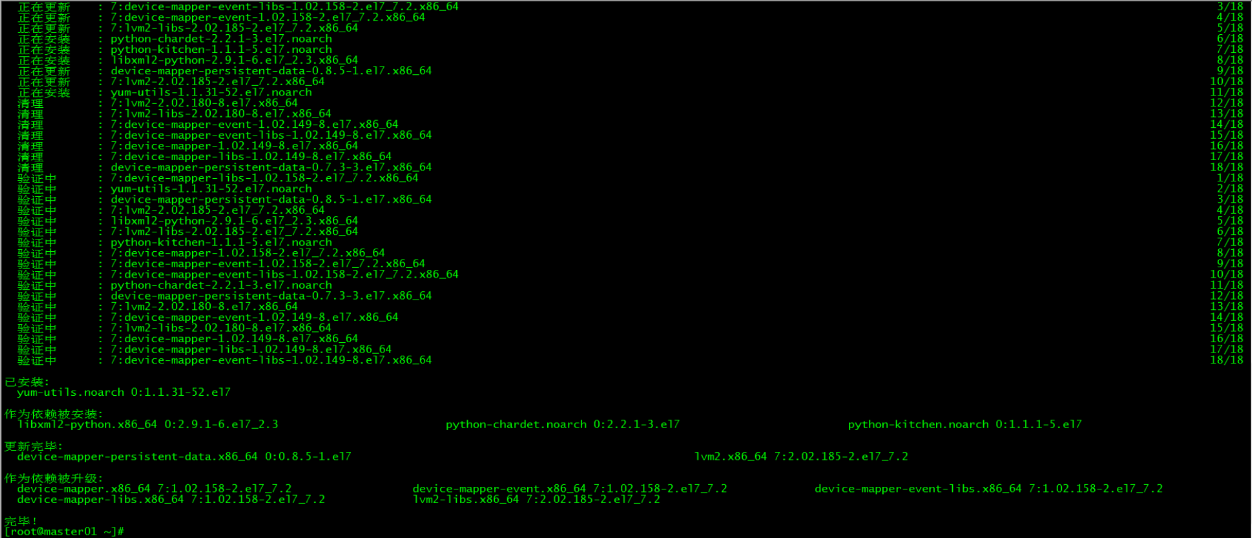

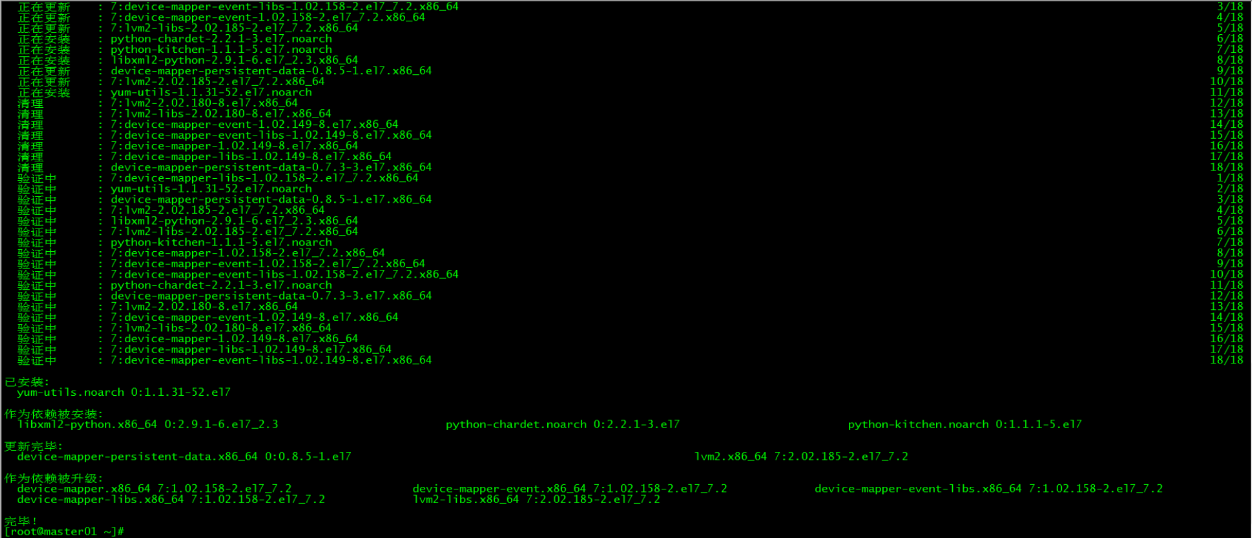

1. ��װ������

[root@master01 ~]

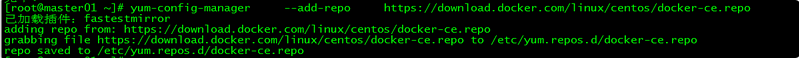

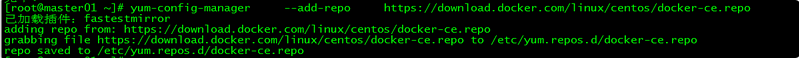

2. ����DockerԴ

[root@master01 ~]

3. ��װDocker CE

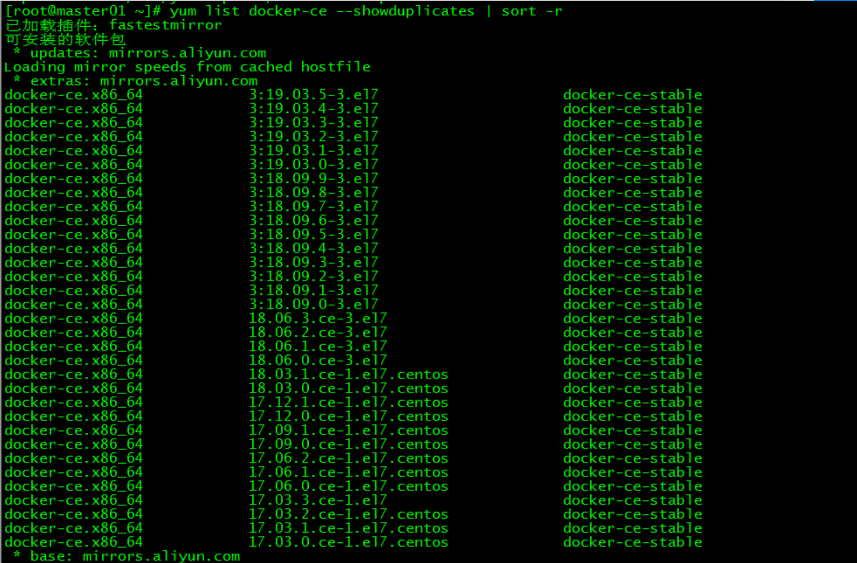

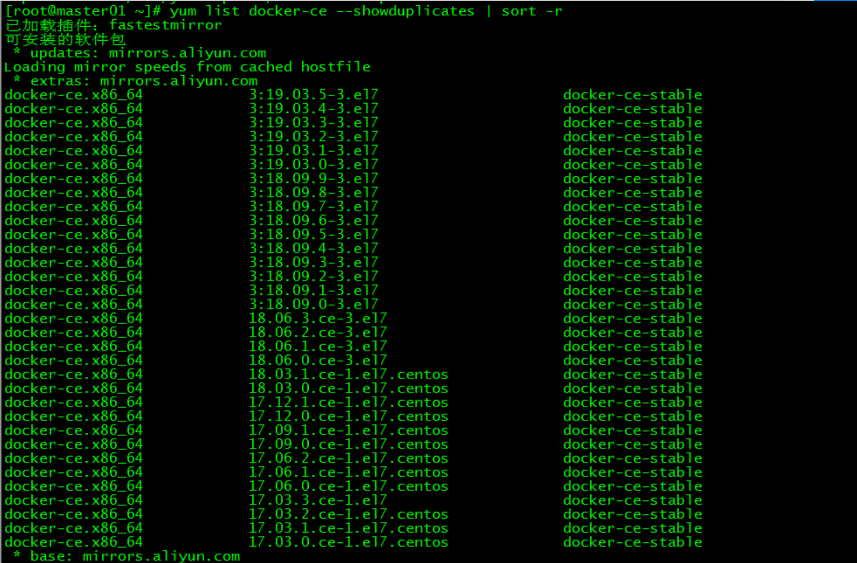

3.1 docker��װ�汾�鿴

[root@master01 ~]

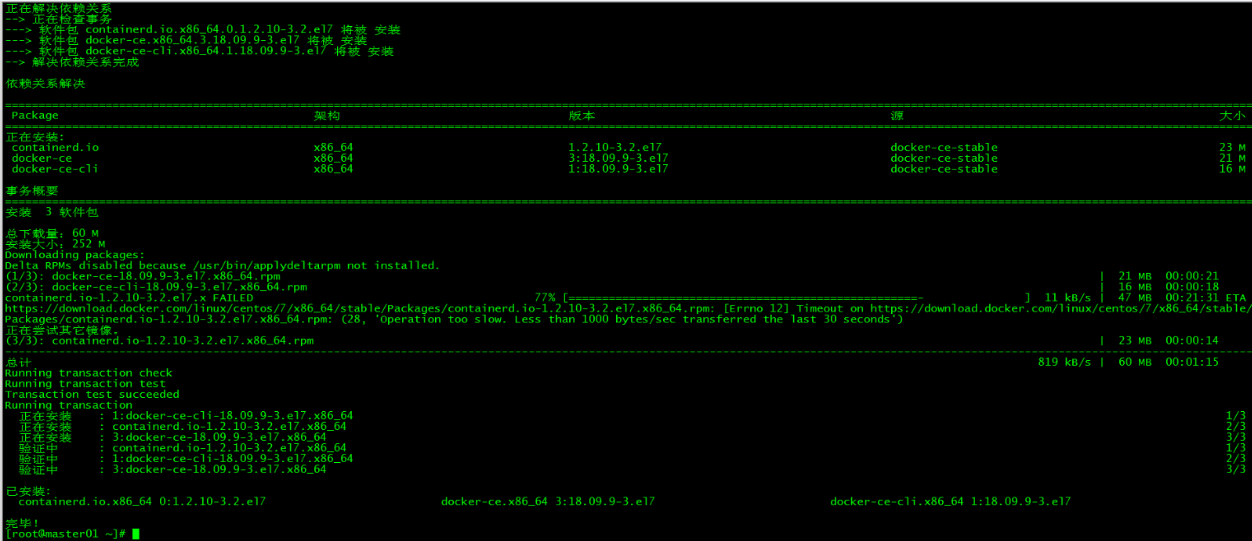

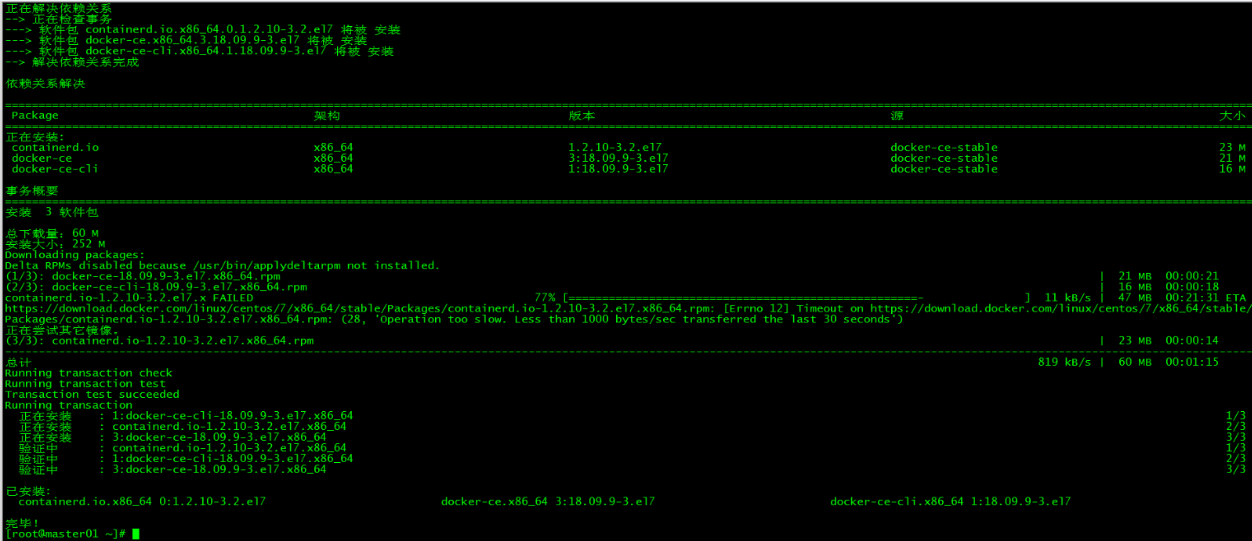

3.2 ��װdocker

[root@master01 ~]

ָ����װ��docker�汾Ϊ18.09.9

4. ����Docker

[root@master01 ~]

[root@master01 ~]

5. ���ȫ

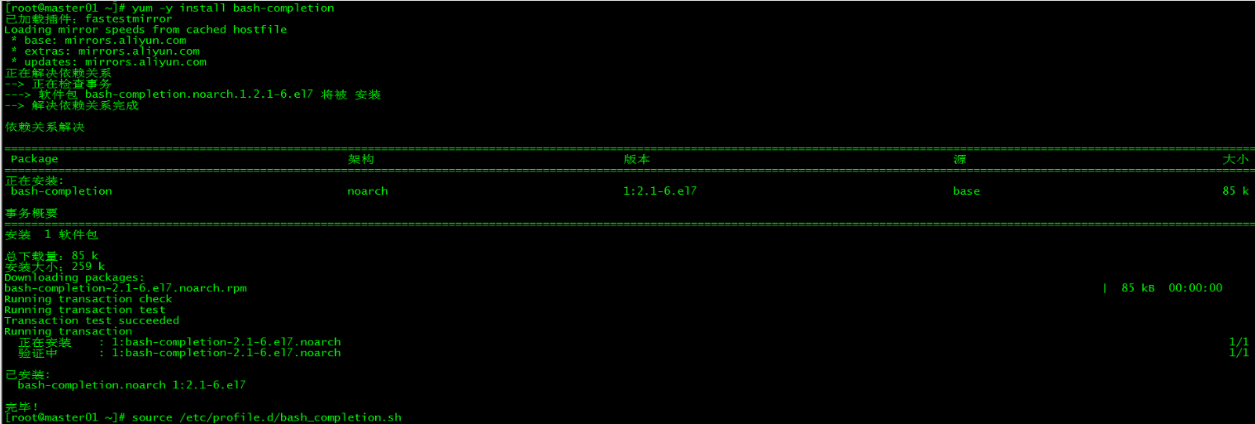

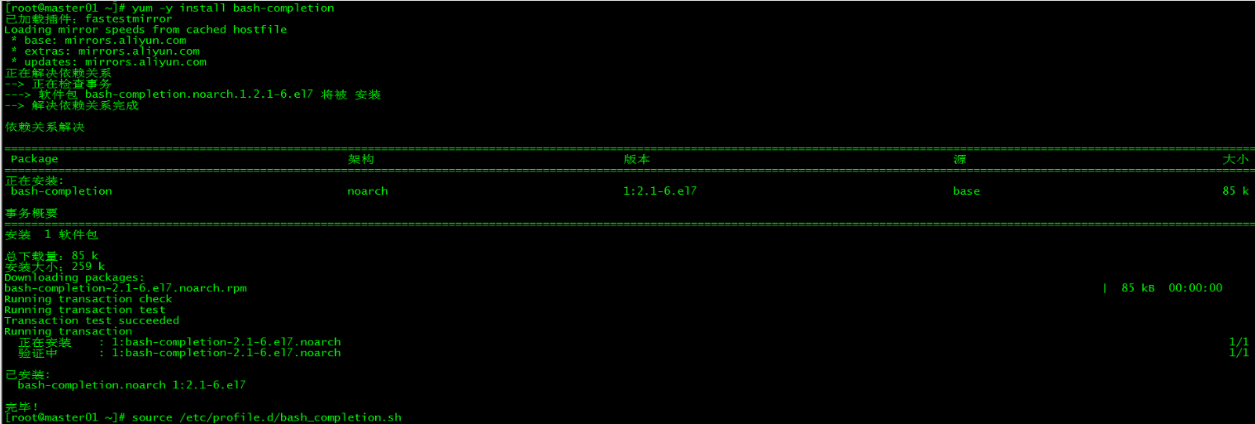

5.1 ��װbash-completion

[root@master01 ~]

5.2 ����bash-completion

[root@master01 ~]

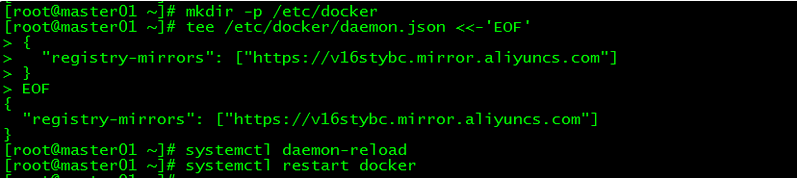

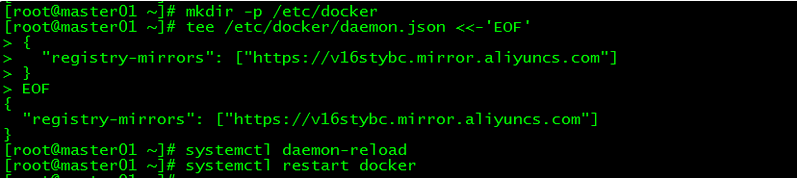

6. �������

����Docker Hub�ķ������ڹ���,���ؾ����Ƚ���,�������þ������������Ҫ�ļ�������:Docker�ٷ��ṩ���й�registry mirror�������Ƽ�������DaoCloud ������,�����������������Ϊ����

6.1 ��½����������ģ��

��½��ַΪ:https://cr.console.aliyun.com ,δע��Ŀ�����ע�ᰢ�����˻�

6.2 ���þ��������

����daemon.json�ļ�

[root@master01 ~]

[root@master01 ~]

{

"registry-mirrors": ["https://v16stybc.mirror.aliyuncs.com"]

}

EOF

��������

[root@master01 ~]

[root@master01 ~]

�������������

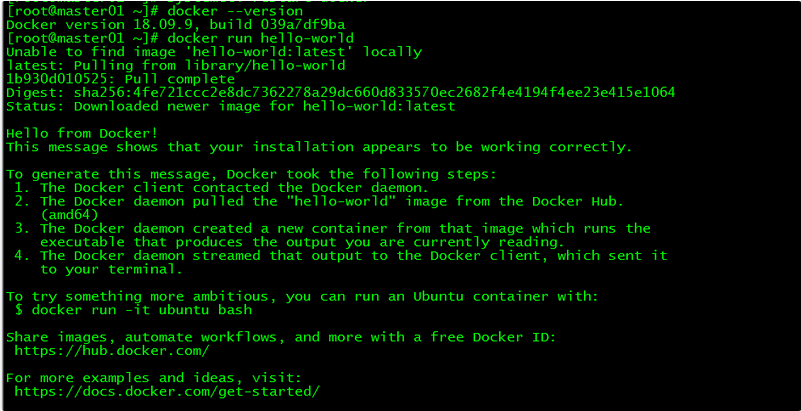

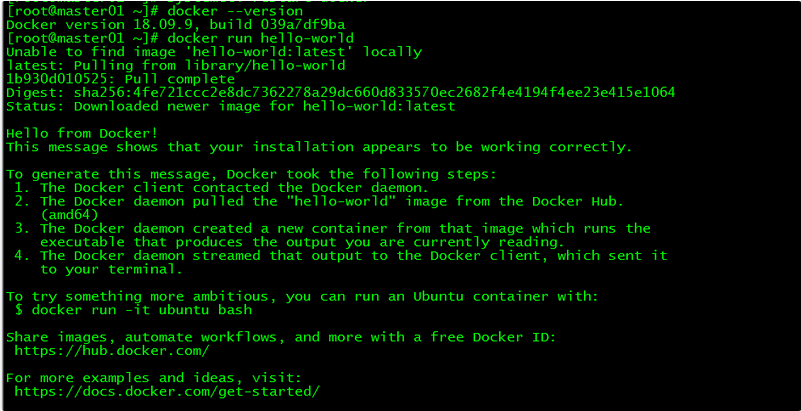

7. ��֤

[root@master01 ~]

[root@master01 ~]

ͨ����ѯdocker�汾����������hello-world����֤docker�Ƿ�װ�ɹ���

8. ��Cgroup Driver

8.1 ��daemon.json

��daemon.json,��������exec-opts��: [��native.cgroupdriver=systemd����

[root@master01 ~]

{

"registry-mirrors": ["https://v16stybc.mirror.aliyuncs.com"],

"exec-opts": ["native.cgroupdriver=systemd"]

}

8.2 ���¼���docker

[root@master01 ~]

[root@master01 ~]

��cgroupdriver��Ϊ�������澯:

[WARNING IsDockerSystemdCheck]: detected ��cgroupfs�� as the Docker cgroup driver. The recommended driver is ��systemd��. Please follow the guide at https://kubernetes.io/docs/setup/cri/

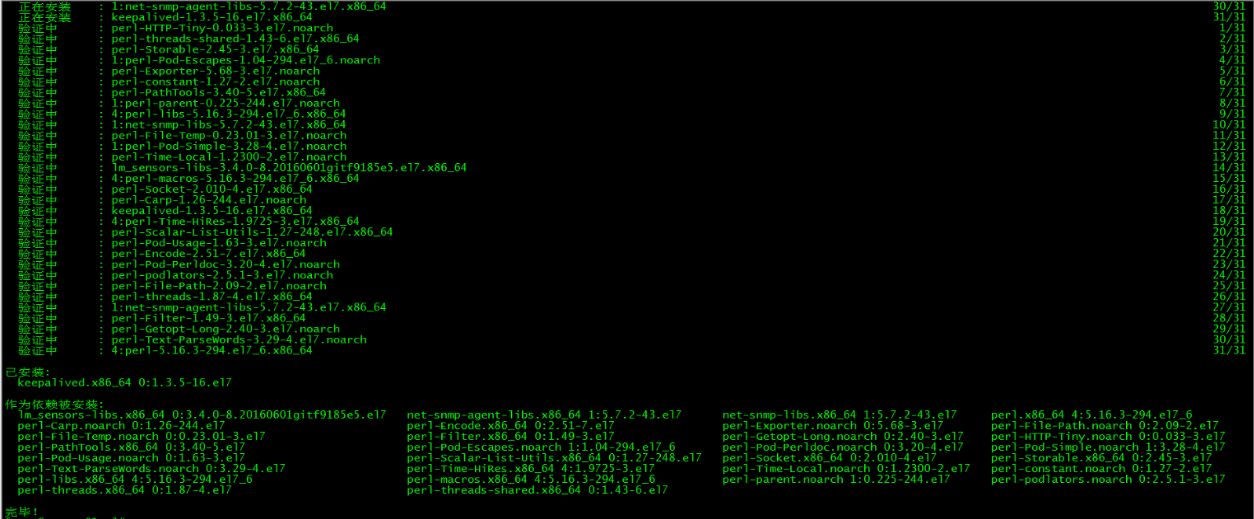

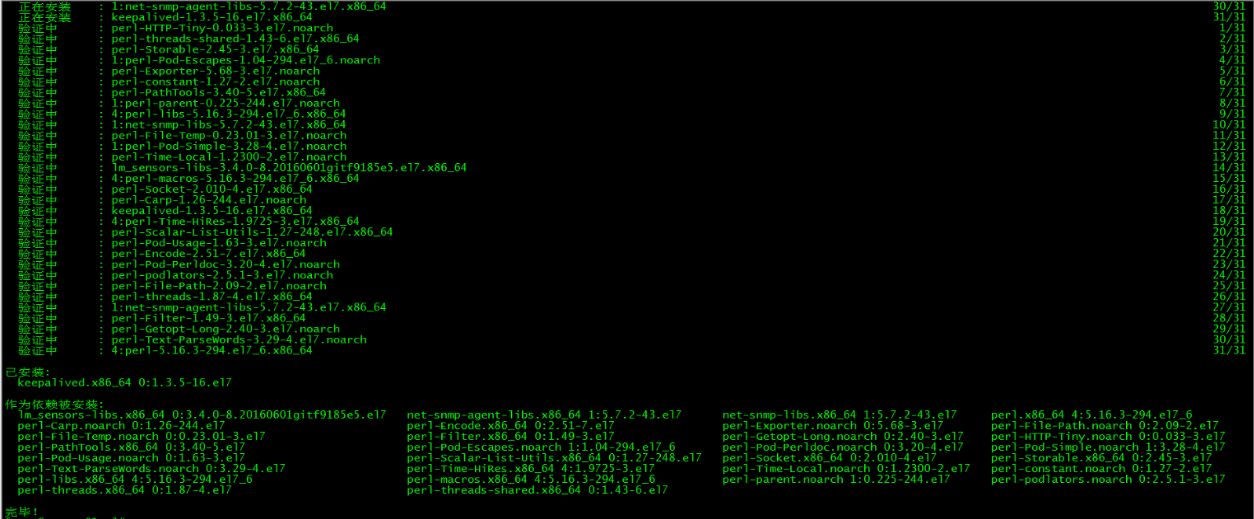

�塢keepalived��װ

control plane�ڵ㶼ִ�б����ֲ�����

1. ��װkeepalived

[root@master01 ~]

2. keepalived����

master01��keepalived����:

[root@master01 ~]

! Configuration File for keepalived

global_defs {

router_id master01

}

vrrp_instance VI_1 {

state MASTER

interface ens160

virtual_router_id 50

priority 100

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.27.34.130

}

}

master02��keepalived����:

[root@master02 ~]

! Configuration File for keepalived

global_defs {

router_id master02

}

vrrp_instance VI_1 {

state BACKUP

interface ens160

virtual_router_id 50

priority 90

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.27.34.130

}

}

master03��keepalived����:

[root@master03 ~]

! Configuration File for keepalived

global_defs {

router_id master03

}

vrrp_instance VI_1 {

state BACKUP

interface ens160

virtual_router_id 50

priority 80

advert_int 1

authentication {

auth_type PASS

auth_pass 1111

}

virtual_ipaddress {

172.27.34.130

}

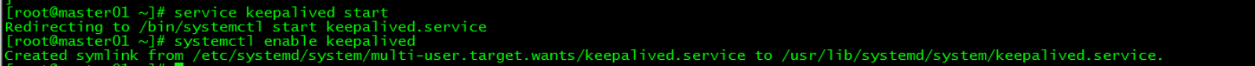

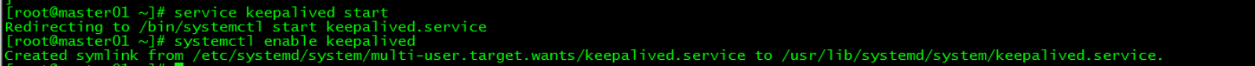

3. ����keepalived

����control plane����keepalived�������ÿ�������

[root@master01 ~]

[root@master01 ~]

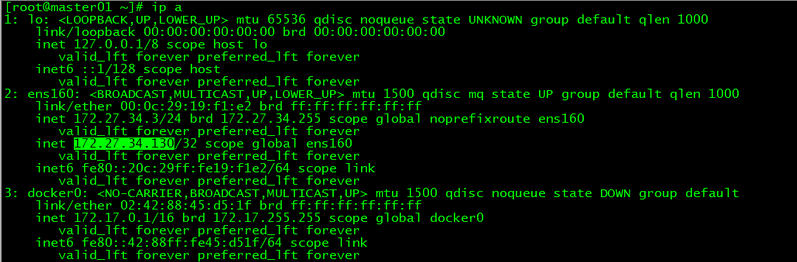

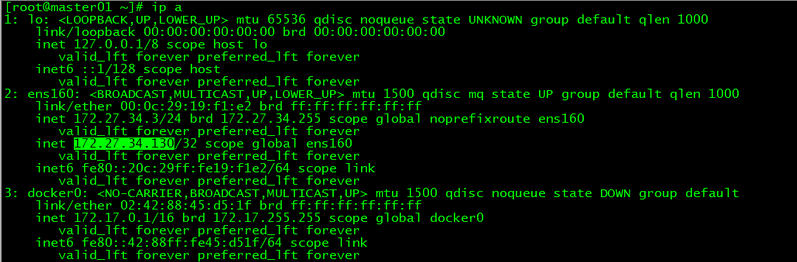

4. VIP�鿴

[root@master01 ~]

vip��master01��

����k8s��װ

control plane��work�ڵ㶼ִ�б����ֲ�����

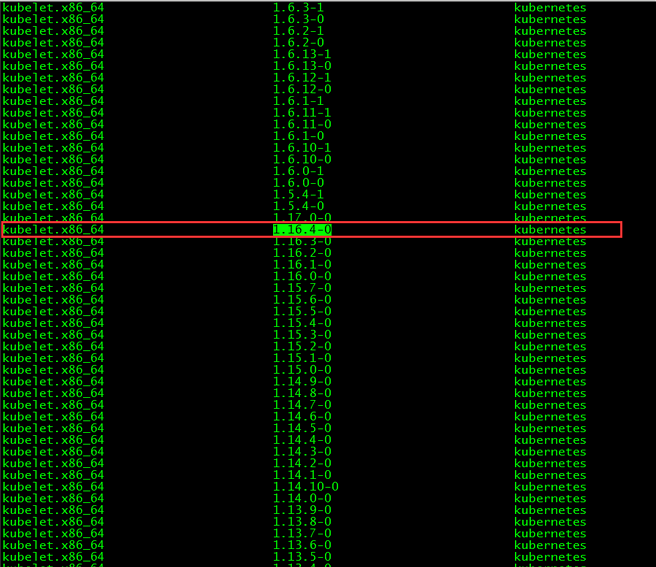

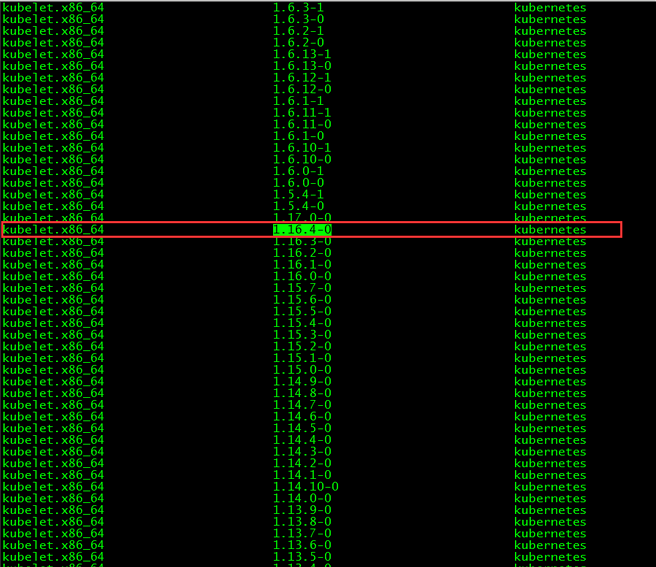

1. �汾�鿴

[root@master01 ~]

���İ�װ��kubelet�汾��1.16.4,�ð汾֧�ֵ�docker�汾Ϊ1.13.1, 17.03, 17.06, 17.09, 18.06, 18.09��

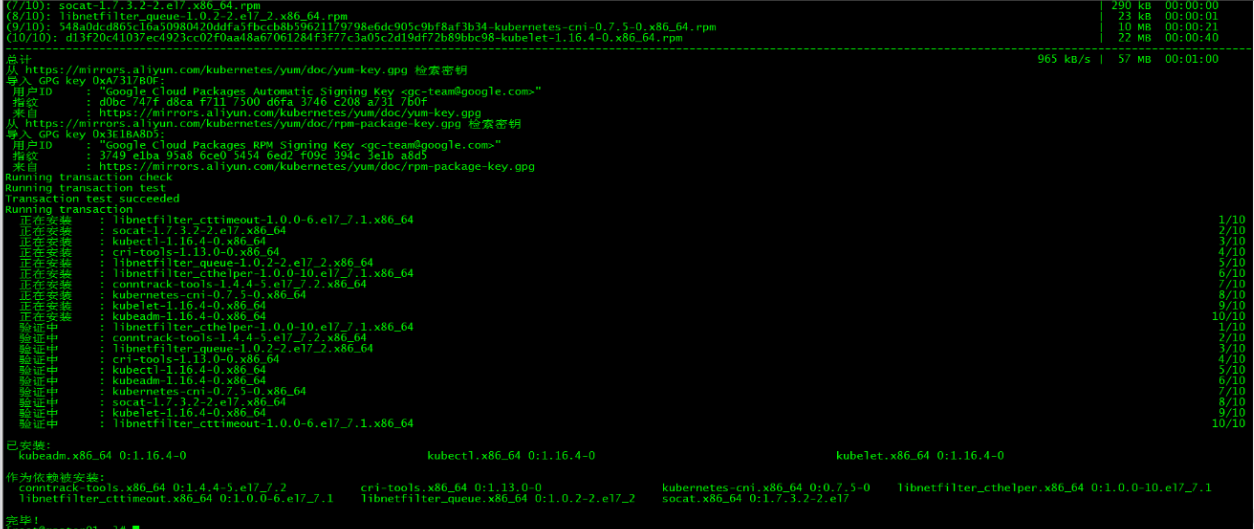

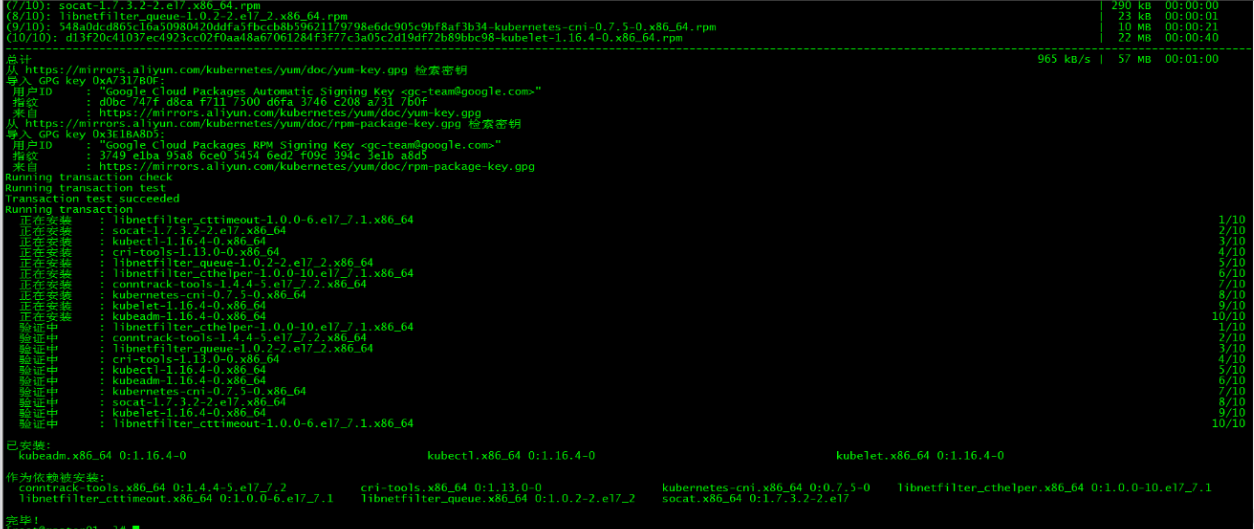

2. ��װkubelet��kubeadm��kubectl

2.1 ��װ������

[root@master01 ~]

2.2 ��װ��˵��

- kubelet �����ڼ�Ⱥ���нڵ���,��������Pod�������ȶ���Ĺ���

- kubeadm ���ڳ�ʼ����Ⱥ,������Ⱥ�������

- kubectl ���ںͼ�Ⱥͨ�ŵ�������,ͨ��kubectl���Բ������Ӧ��,�鿴������Դ,������ɾ�����¸������

2.3 ����kubelet

����kubelet�����ÿ�������

[root@master01 ~]

2.4 kubectl���ȫ

[root@master01 ~]

[root@master01 ~]

3. ���ؾ���

3.1 �������صĽű�

Kubernetes�������еİ�װ�����Docker������goolge�Լ�����վ��,ֱ�ӷ��ʿ��ܻ�����������,����Ľ���취�ǴӰ����ƾ���ֿ����ؾ���,��ȡ�������Ժ�Ļ�Ĭ�ϵľ���tag������ͨ������image.sh�ű���ʽ��ȡ������дimages�ļ�,������ִ��Ȩ��