��̬��ҳ��ȡ������ѧϰ�е�һ���ѵ㡣���Ľ���֪���廭��վpixivΪ������Ҫ���ܶ�̬��ҳ��ȡ�ķ�����

д��ǰ��

������Ĺ��������뻭ʦ��pixiv id�����ػ�ʦ�����в廭�����ڱ���ˮƽ���ޣ����Դ��벻��ʵ���Զ���¼pixiv����Ҫ������ʱ�ֶ�������վ��cookieֵ��

�ص㣺����ͷ�Ĺ��죬json�ļ���ַ�IJ��ң�json����Ϣ����ȡ

����

�����ļ���

���ݻ�ʦ��id�����ļ��У����·����Ҫ���е�������

def makefolder(id): # ���ݻ�ʦ��id������Ӧ���ļ���

try:

folder = os.path.join('E:\pixivimages', id)

os.mkdir(folder)

return folder

except(FileExistsError):

print('the folder exists!')

exit()

��ȡ��������ͼƬ��id

����url��https://pixiv.net/ajax/user/��ʦid/profile/all�����json�����ڻ�ʦ��ҳurl��https://www.pixiv.net/users/��ʦid �Ŀ�����������ҵ�����ͼ����

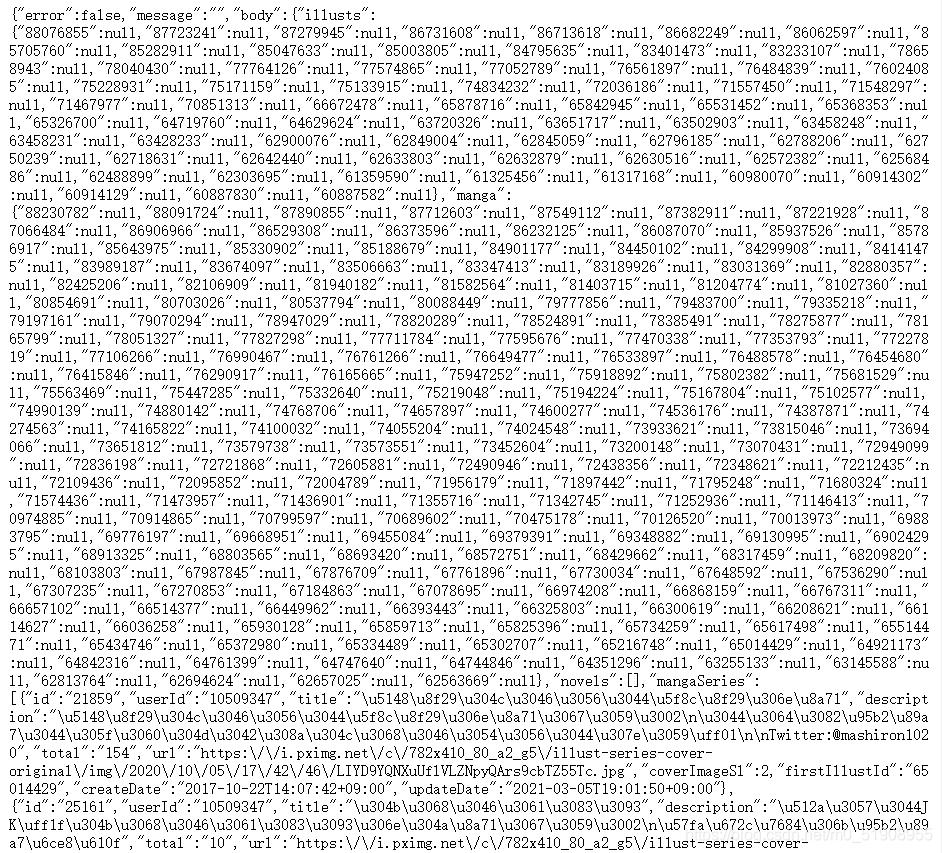

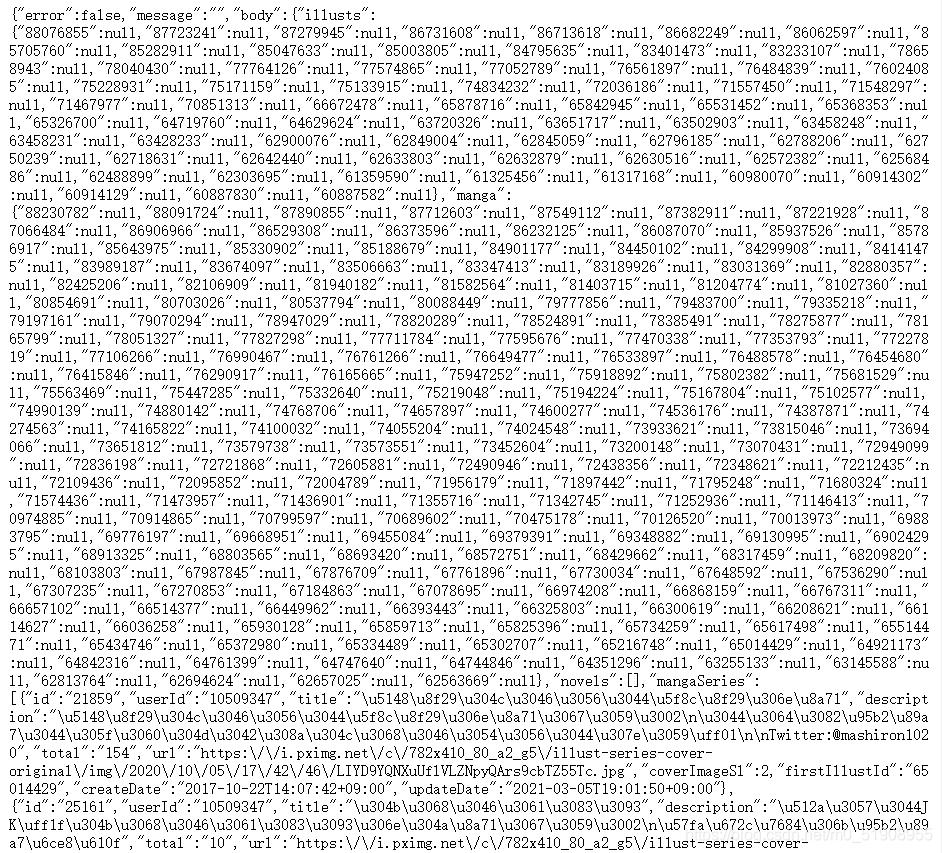

json���ݣ�

��json�ĵ�ת��Ϊpython���ֵ䣬��ȡ��ӦԪ�ؼ��ɻ�ȡ���еIJ廭id��

def getAuthorAllPicID(id, cookie): # ��ȡ��ʦ����ͼƬ��id

url = 'https://pixiv.net/ajax/user/' + id + '/profile/all' # ���ʴ��л�ʦ������Ʒ

headers = {

'User-Agent': user_agent,

'Cookie': cookie,

'Referer': 'https://www.pixiv.net/artworks/'

# referer����ȱ�٣������403

}

res = requests.get(url, headers=headers, proxies=proxies)

if res.status_code == 200:

resdict = json.loads(res.content)['body']['illusts'] # ��jsonת��Ϊpython���ֵ����ȡԪ��

return [key for key in resdict] # ��������ͼƬid

else:

print("Can not get the author's picture ids!")

exit()

��ȡͼƬ����ʵurl������

����url:https://www.pixiv.net/ajax/illust/ͼƬid?lang=zh�����Կ���������ͼƬ��ʵ��ַ��json�������json������ͼƬurl��https://www.pixiv.net/artworks/ͼƬid �Ŀ�����������ҵ���

��ͬ���ķ�����ȡjson�����õ�Ԫ�أ�

def getPictures(folder, IDlist, cookie): # ����ͼƬ�������ʵ��ַ

for picid in IDlist:

url1 = 'https://www.pixiv.net/artworks/{}'.format(picid) # ע������referer�ز�����,����ᱨ403

headers = {

'User-Agent': user_agent,

'Cookie': cookie,

'Referer': url1

}

url = 'https://www.pixiv.net/ajax/illust/' + str(picid) + '?lang = zh' #���ʴ���ͼƬ��ַ��json

res = requests.get(url, headers=headers, proxies=proxies)

if res.status_code == 200:

data = json.loads(res.content)

picurl = data['body']['urls']['original'] # ���ֵ����ҵ�����ͼƬ��·�������

title = data['body']['title']

title = changeTitle(title) # ��������

print(title)

print(picurl)

download(folder, picurl, title, headers)

else:

print("Can not get the urls of the pictures!")

exit()

def changeTitle(title): # Ϊ�˷�ֹ

global i

title = re.sub('[*:]', "", title) # ���ͼƬ�������з���,���ܻᵼ��ͼƬ���ɹ�����

# ע����ܻ���������������ļ������ķ���,����ҵ���Ӧ����Ҫ�������ӵ��������ʽ��

if title == '�o�}': # pixiv����������Ϊ'�o�}'(����)��ͼƬ,��Ҫ�����Ǽ��������Է�ֹ����

title = title + str(i)

i = i + 1

return title

def download(folder, picurl, title, headers): # ��ͼƬ���ص��ļ�����

img = requests.get(picurl, headers=headers, proxies=proxies)

if img.status_code == 200:

with open(folder + '\\' + title + '.jpg', 'wb') as file: # ����ͼƬ

print("downloading:" + title)

file.write(img.content)

else:

print("download pictures error!")

��������

import requests

from fake_useragent import UserAgent

import json

import re

import os

global i

i = 0

ua = UserAgent() # ���ɼٵ����������ͷ,��ֹ����ip

user_agent = ua.random # ���ѡ��һ�������

proxies = {'http': 'http://127.0.0.1:51837', 'https': 'http://127.0.0.1:51837'} # ����,�����Լ�ʵ���������,ע��������ʱһ����Ҫ���Ǵ���!!

def makefolder(id): # ���ݻ�ʦ��id������Ӧ���ļ���

try:

folder = os.path.join('E:\pixivimages', id)

os.mkdir(folder)

return folder

except(FileExistsError):

print('the folder exists!')

exit()

def getAuthorAllPicID(id, cookie): # ��ȡ��ʦ����ͼƬ��id

url = 'https://pixiv.net/ajax/user/' + id + '/profile/all' # ���ʴ��л�ʦ������Ʒ

headers = {

'User-Agent': user_agent,

'Cookie': cookie,

'Referer': 'https://www.pixiv.net/artworks/'

}

res = requests.get(url, headers=headers, proxies=proxies)

if res.status_code == 200:

resdict = json.loads(res.content)['body']['illusts'] # ��jsonת��Ϊpython���ֵ����ȡԪ��

return [key for key in resdict] # ��������ͼƬid

else:

print("Can not get the author's picture ids!")

exit()

def getPictures(folder, IDlist, cookie): # ����ͼƬ�������ʵ��ַ

for picid in IDlist:

url1 = 'https://www.pixiv.net/artworks/{}'.format(picid) # ע������referer�ز�����,����ᱨ403

headers = {

'User-Agent': user_agent,

'Cookie': cookie,

'Referer': url1

}

url = 'https://www.pixiv.net/ajax/illust/' + str(picid) + '?lang = zh' #���ʴ���ͼƬ��ַ��json

res = requests.get(url, headers=headers, proxies=proxies)

if res.status_code == 200:

data = json.loads(res.content)

picurl = data['body']['urls']['original'] # ���ֵ����ҵ�����ͼƬ��·�������

title = data['body']['title']

title = changeTitle(title) # ��������

print(title)

print(picurl)

download(folder, picurl, title, headers)

else:

print("Can not get the urls of the pictures!")

exit()

def changeTitle(title): # Ϊ�˷�ֹ

global i

title = re.sub('[*:]', "", title) # ���ͼƬ�������з���,���ܻᵼ��ͼƬ���ɹ�����

# ע����ܻ���������������ļ������ķ���,����ҵ���Ӧ����Ҫ�������ӵ��������ʽ��

if title == '�o�}': # pixiv����������Ϊ'�o�}'(����)��ͼƬ,��Ҫ�����Ǽ��������Է�ֹ����

title = title + str(i)

i = i + 1

return title

def download(folder, picurl, title, headers): # ��ͼƬ���ص��ļ�����

img = requests.get(picurl, headers=headers, proxies=proxies)

if img.status_code == 200:

with open(folder + '\\' + title + '.jpg', 'wb') as file: # ����ͼƬ

print("downloading:" + title)

file.write(img.content)

else:

print("download pictures error!")

def main():

global i

id = input('input the id of the artist:')

cookie = input('input your cookie:') # ���Զ�����,��Ҫ�Լ����ȵ�¼pixiv�Ի�ȡcookie

folder = makefolder(id)

IDlist = getAuthorAllPicID(id, cookie)

getPictures(folder, IDlist, cookie)

if __name__ == '__main__':

main()

��

�ܽ�

jsjbwy