ҙнОуҙъВлЈәКдіцgradОӘnone

a = torch.ones((2, 2), requires_grad=True).to(device)

b = a.sum()

b.backward()

print(a.grad)

УЙУЪ.to(device)КЗТ»ҙОІЩЧчЈ¬ҙЛКұөДaТСҫӯІ»КЗТ¶ЧУҪЪөгБЛ

РЮёДәуөДҙъВлОӘЈә

a = torch.ones((2, 2), requires_grad=True)

c = a.to(device)

b = c.sum()

b.backward()

print(a.grad)

АаЛЖҙнОуЈә

self.miu = torch.nn.Parameter(torch.ones(self.dimensional)) * 0.01

УҰёГОӘ

self.miu = torch.nn.Parameter(torch.ones(self.dimensional) * 0.01)

І№ідЈәpytorchМЭ¶И·ө»ШnoneөДbug

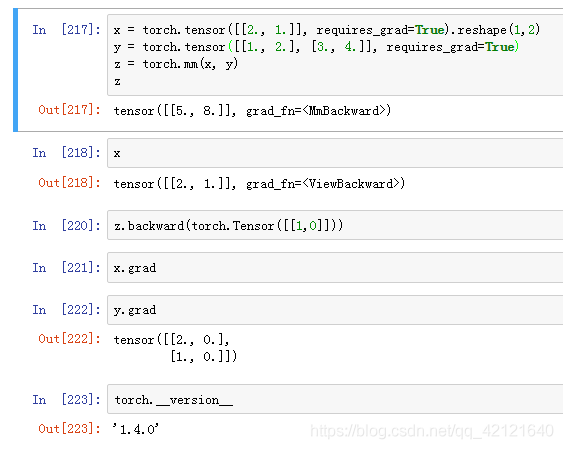

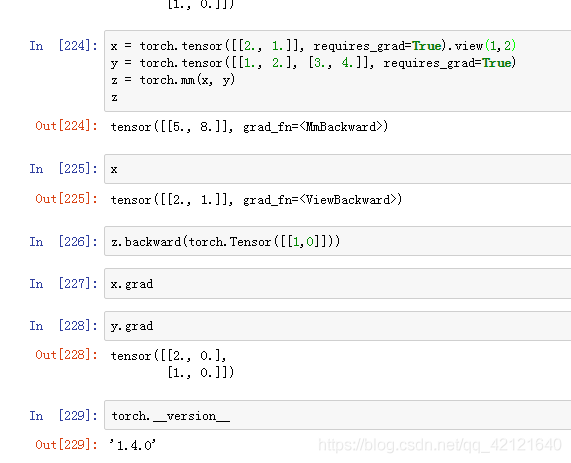

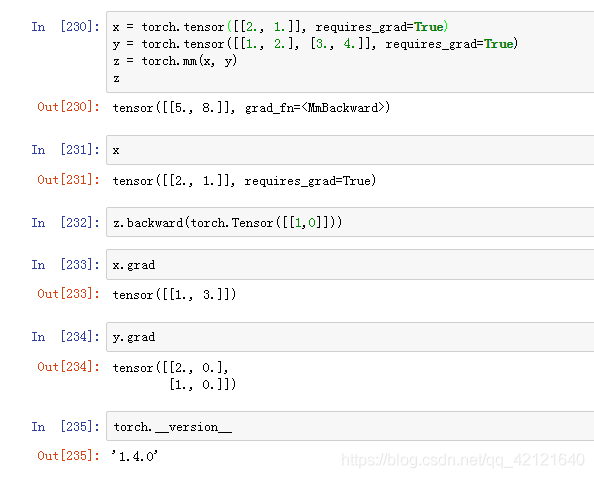

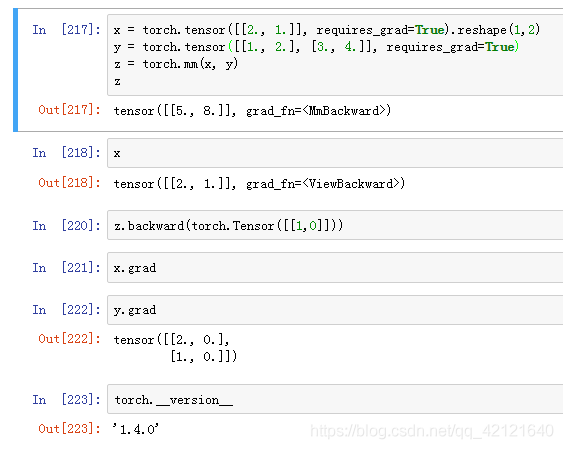

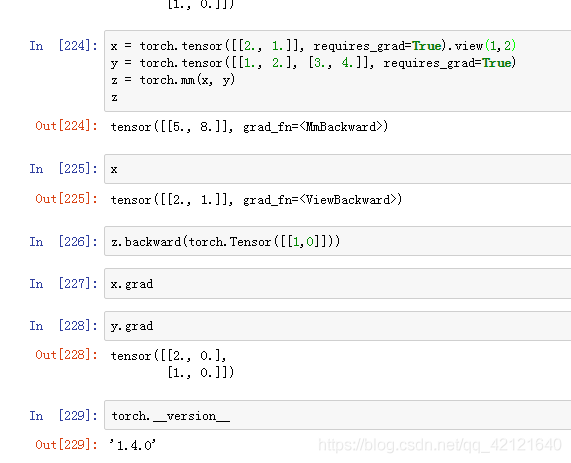

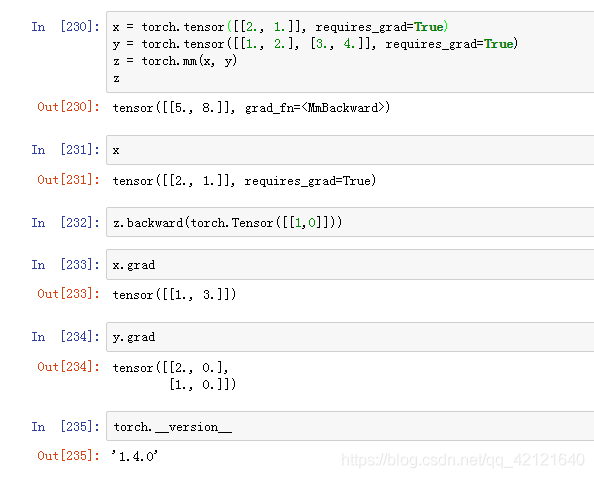

pytorch1.4.0Из№ыК№УГБЛview·Ҫ·ЁЈ¬reshape·Ҫ·Ё

tensorјҙК№ЙиЦГБЛrequires_gradЈ¬·ҙПтҙ«ІҘЦ®әуЈ¬ x·ө»ШГ»УРgradМЭ¶ИЈ¬ОӘnone

І»ЦӘөАЖдЛы°жұҫУРОЮҙЛbug

І№ідЈәPyTorchЦРМЭ¶И·ҙПтҙ«ІҘөДЧўТвөг

ФЪТ»ёцөьҙъСӯ»·ЦР

optimizer.zero_grad()УпҫдөДО»ЦГұИҪПЛжТвЈ¬Ц»ТӘ·ЕФЪloss.backward()З°ГжјҙҝЙЈ¬ЛьөДЧчУГКЗҪ«МЭ¶И№йБгЈ¬·сФт»бФЪГҝТ»ёцөьҙъЦРҪшРРАЫјУЈ¬

loss.backward()өДЧчУГКЗ·ҙПтҙ«ІҘЈ¬јЖЛгМЭ¶ИЈ¬optimizer.step()өД№ҰДЬКЗУЕ»ҜЖчЧФ¶ҜНкіЙІОКэөДёьРВЎЈ

optimizer.zero_grad()

loss.backward()

optimizer.step()

ТФЙПОӘёцИЛҫӯСйЈ¬ПЈНыДЬёшҙујТТ»ёцІОҝјЈ¬ТІПЈНыҙујТ¶а¶аЦ§іЦХҫіӨІ©ҝНЎЈ

js