优化器总结

机器学习中,有很多优化方法来试图寻找模型的最优解。比如神经网络中可以采取最基本的梯度下降法。

梯度下降法(Gradient Descent)

梯度下降法是最基本的一类优化器,目前主要分为三种梯度下降法:标准梯度下降法(GD, Gradient Descent),随机梯度下降法(SGD, Stochastic Gradient Descent)及批量梯度下降法(BGD, Batch Gradient Descent)。

标准梯度下降法(GD)

- 假设要学习训练的模型参数为WW,代价函数为J(W)J(W),则代价函数关于模型参数的偏导数即相关梯度为ΔJ(W)ΔJ(W),学习率为ηtηt,则使用梯度下降法更新参数为:

其中,WtWt表示tt时刻的模型参数。

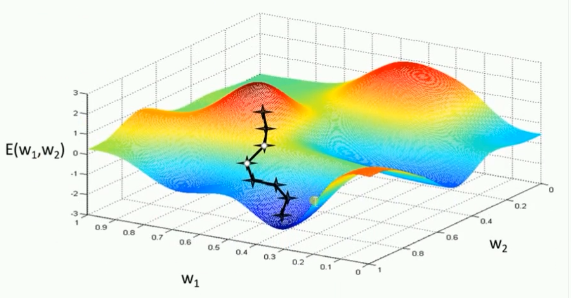

- 从表达式来看,模型参数的更新调整,与代价函数关于模型参数的梯度有关,即沿着梯度的方向不断减小模型参数,从而最小化代价函数。

- 基本策略可以理解为”在有限视距内寻找最快路径下山“,因此每走一步,参考当前位置最陡的方向(即梯度)进而迈出下一步。可以形象的表示为:

评价:标准梯度下降法主要有两个缺点:

- 训练速度慢:每走一步都要要计算调整下一步的方向,下山的速度变慢。在应用于大型数据集中,每输入一个样本都要更新一次参数,且每次迭代都要遍历所有的样本。会使得训练过程及其缓慢,需要花费很长时间才能得到收敛解。

- 容易陷入局部最优解:由于是在有限视距内寻找下山的反向。当陷入平坦的洼地,会误以为到达了山地的最低点,从而不会继续往下走。所谓的局部最优解就是鞍点。落入鞍点,梯度为0,使得模型参数不在继续更新。

批量梯度下降法(BGD)

- 假设批量训练样本总数为nn,每次输入和输出的样本分别为X(i),Y(i)X(i),Y(i),模型参数为WW,代价函数为J(W)J(W),每输入一个样本ii代价函数关于WW的梯度为ΔJi(Wt,X(i),Y(i))ΔJi(Wt,X(i),Y(i)),学习率为ηtηt,则使用批量梯度下降法更新参数表达式为:

其中,WtWt表示tt时刻的模型参数。

- 从表达式来看,模型参数的调整更新与全部输入样本的代价函数的和(即批量/全局误差)有关。即每次权值调整发生在批量样本输入之后,而不是每输入一个样本就更新一次模型参数。这样就会大大加快训练速度。

- 基本策略可以理解为,在下山之前掌握了附近的地势情况,选择总体平均梯度最小的方向下山。

评价:

- 批量梯度下降法比标准梯度下降法训练时间短,且每次下降的方向都很正确。

随机梯度下降法(SGD)

- 对比批量梯度下降法,假设从一批训练样本nn中随机选取一个样本isis。模型参数为WW,代价函数为J(W)J(W),梯度为ΔJ(W)ΔJ(W),学习率为ηtηt,则使用随机梯度下降法更新参数表达式为:

- E(gt)=ΔJ(Wt)E(gt)=ΔJ(Wt),这里虽然引入了随机性和噪声,但期望仍然等于正确的梯度下降。

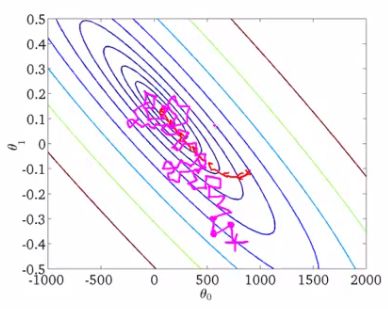

- 基本策略可以理解为随机梯度下降像是一个盲人下山,不用每走一步计算一次梯度,但是他总能下到山底,只不过过程会显得扭扭曲曲。

评价:

- 优点:

- 虽然SGD需要走很多步的样子,但是对梯度的要求很低(计算梯度快)。而对于引入噪声,大量的理论和实践工作证明,只要噪声不是特别大,SGD都能很好地收敛。

- 应用大型数据集时,训练速度很快。比如每次从百万数据样本中,取几百个数据点,算一个SGD梯度,更新一下模型参数。相比于标准梯度下降法的遍历全部样本,每输入一个样本更新一次参数,要快得多。

- 缺点:

- SGD在随机选择梯度的同时会引入噪声,使得权值更新的方向不一定正确。

- 此外,SGD也没能单独克服局部最优解的问题

动量优化法

动量优化方法是在梯度下降法的基础上进行的改变,具有加速梯度下降的作用。一般有标准动量优化方法Momentum、NAG(Nesterov accelerated gradient)动量优化方法。

NAG在Tensorflow中与Momentum合并在同一函数tf.train.MomentumOptimizer中,可以通过参数配置启用。

Momentum

- 使用动量(Momentum)的随机梯度下降法(SGD),主要思想是引入一个积攒历史梯度信息动量来加速SGD。

- 从训练集中取一个大小为nn的小批量{X(1),X(2),...,X(n)}{X(1),X(2),...,X(n)}样本,对应的真实值分别为Y(i)Y(i),则Momentum优化表达式为: